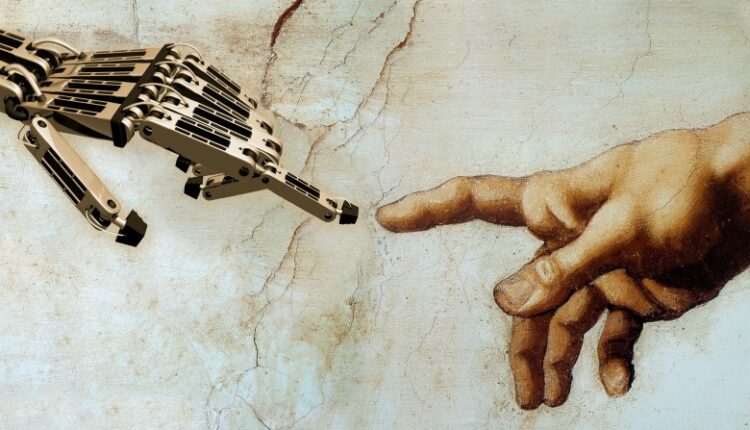

این گزارش مخاطب را در مقابل این پرسش شگرف قرار می دهد: آیا هوش مصنوعی انسانهایی را که میتوانستند و میدانستند، اما نخواستند که او را اختراع کنند را مجازات میکند و یا جهانی یوتوپیایی را رقم میزند که در آن بشریت به آرزوهای دست نیافتهاش میرسد؟

به گزارش ردنا (ادیان نیوز)، اکنون که هوش مصنوعی بر سر زبانها افتاده است، مهندسان و برنامهنویسان آن به جان یکدیگر افتادهاند و یکی از این دو موضع را بر میگزینند: تکینگی و خودبسندگی لجام گسیخته هوش مصنوعی و یا آیندهای گل و بلبل به همراه آن! آیا هوش مصنوعی انسانهایی را که میتوانستند و میدانستند، اما نخواستند که او را اختراع کنند را مجازات میکند و یا جهانی یوتوپیایی را رقم میزند که در آن بشریت به آرزوهای دست نیافتهاش میرسد؟ پروفسور هنری فارل با شرح و بسط دو موضع نظری مذکور و پاسخ به سوالاتی مانند سوالات فوق، اذعان میکند که مجادلات و مباحثات شکل گرفته درباره هوش مصنوعی مانند اختلافات فرقههای مذهبی به نظر میآیند. گویی که این فرقهها هوش خداگونه را میپرستند و درباره معبود خود، استدلالهای کلامی مختلفی دارند..

دو قرن پیش، هانری سن سیمون -یوتوپیا نگار فرانسوی- از دین جدیدی صحبت کرد که نیروی خداگونه پیشرفت در آن پرستیده میشد و آیزاک نیوتن قدیس اعظم آن بود. او معتقد بود که تنها انگیزه متحد کننده بشریت یعنی «پیشرفت علوم» باید توسط «برگزیدگان بشریت» یا همان «شورای ۲۱ نفره نیوتن» هدایت شود. فردریش هایک -اقتصاددان قرن بیستمی- بعداً با مسرت شرح داد که چگونه این «دین مضحکِ مهندسان» با تقسیم شدن به انبوهی از فرقه های متخاصم، متلاشی شد.

امروزه مهندسان هوش مصنوعی در حال تجربه تفرقه مذهبی متعلق به خود هستند. یک فرقه از آنها پیشرفت را میپرستد و خودِ هایک را مقدس میشمارد. دیگری گرفتار وحشت از نیروهای خداگونه است. نبرد این فرقهها پرسشهای عملگرایانه را به حاشیههای بحث سوق داده است.

هر دو فرقه محصول غیرمنتظره داستانهای علمی تخیلی هستند. در سال ۱۹۹۳ ورنور وینگ با یاری جستن از علوم کامپیوتر و دوستان علمی-تخیلی نویسندهاش استدلال کرد که تاریخ بشر به تدریج به پایان خود نزدیک شده است.او میگفت ما مطمئناً در سه دهه آینده هوشی مافوق بشری ایجاد خواهیم کرد که منجر به تکینگیای می شود که از طریق آن، هوش فرا انسانی خودبسنده می شود و از خودش تغذیه میکند. آینده ممکن است بسته به این که آیا ماشینها هوش انسانی را تقویت می کنند یا جایگزین آن میشوند، خوشایند یا ترسناک باشد.

برخی خوشبین بودند. ری کورزویل -آینده پژوه- کتاب بسیار حجیمی به نام «تکینگی نزدیک است» نوشت و تحولی تاریخی در سال ۲۰۴۵ را در این کتاب پیشبینی کرد. ما انسانها فنا ناپذیر میشویم، هوش را در سرتاسر هستی انتشار میدهیم و در نهایت تبدیل به خدا میشویم. علی رغم تمام آمارها و نماییهای موجود در کتاب، همانگونه که یکی از منتقدان نامهربان آن گفته بود، ا عنوان کتاب به درستی باید «تکینگی نزدیک است امّا نمی دانیم کِی؟» میبود!

دیگران از قیامتی که هوش مصنوعی به پا میکند، می ترسیدند. الیزر یودکوفسکی -پژوهشگر خودآموخته هوش مصنوعی- عمیقاً تحت تأثیر ایدههای آقای وینگ قرار گرفت. او پدر جنبش «خردگرایانه» سیلیکون ولی بود. این جنبش به دنبال بهبود قوه استدلال انسانی بود و میخواست هوش مصنوعی را از نابودی نوع بشر باز دارد.

خردگرایان اعتقاد داشتند که آمار بیزی و نظریه تصمیم میتواند از سوگیری تفکر بشری بکاهد و الگوی رفتاریِ هوشی خداگونه را شکل دهد. آنها مانند فیلسوفان مسیحی قرون وسطاییای که درباره ماهیت فرشتگان بحث میکردند، از مباحثات و مناقشات نظری بیپایان خود لذت میبردند؛ تنها تفاوت این بود که نظریه مقدماتی بازی را جایگزین منطق ارسطویی کرده بودند. گاهی بحثهای آنها خیلی علمی و نخبگانی نبود. آقای یودکوفسکی ایدههای خود را در یک فنفیکشن حماسی ۶۶۰ هزار کلمهای به نام «هری پاتر و روشهای عقلانیت» به شکلی عوامانه و مردمپسند بیان کرد.

خردگرایان میترسیدند که نکند هوش مصنوعی مافوق بشری برترین علایق و منافع ما انسانها را در دل خود جا نداده باشد. یک آزمایش فکریِ بدآوازه به نامِ باسیلیسک روکو که نقش ورژن مدرن شرطبندی پاسکال را ایفا میکرد، ادعا کرد که عقل حکم میکند که هوشهای خداگونهای که در آینده ساخته میشوند هرکسی را که میدانست که هوش مصنوعی امکانِ وجود دارد و خود را وقف به وجود آمدن آن نکرد را شکنجه خواهند کرد. هوش مصنوعی همچنین ممکن است از قدرت استدلالورزی فوقالعاده خود برای فرار از محدودیتهایی که انسانها بر آن تحمیل کردهاند، استفاده کند و برای بقای انسان خطر x (خطر وجودی) ایجاد کند.

خردگرایی توضیح می دهد که چرا پیشگامان هوش مصنوعی نگران خطر x شدند و مدام درباره آن فکر میکردند. سم آلتمن و ایلان ماسک، openai -سازنده chatgpt- را به عنوان یک سازمان غیرانتفاعی تاسیس کردند تا این سازمان نیز از خطرات هوش مصنوعی در امان نباشد. امّا با سرایز شدن منابع مالی به این سازمان انگیزهها تغییر کرد. بعضی از کارمندان openai از این مسئله میترسیدند که کارفرمای آنها به فرصتهای هوش مصنوعی بیشتر از خطرات آن اهمیت می دهد. بنابراین آنها openai را ترک کردند تا شرکت anthropic را که رقیب openaiمحسوب می شود، تاسیس کنند. از قرار معلوم اخیراً درگیریها برسر مخاطرات هوش مصنوعی و ثروت و قدرت ناشی از آن منجر به اختلاف و جدایی بین آقای آلتمن و هیئت مدیره او شده است.

اگر خردگرایان از مدل سود سیلیکونولی سرخورده شدند، همزمان سیلیکونولی نیز به شکلی فزاینده از خردگرایی سرخورده و ناامید میشود. مارک اندریسن، یکی از بنیانگذاران اندریسن هوروویتز- یک شرکت سرمایهگذاری خطرپذیر- در ماه ژوئن به شدت اعتراض کرد که «فرقه» افراطی معتقد به خطرات هوش مصنوعی، مانع ظهور آیندهای درخشان همراه با هوش مصنوعی میشود که در آن بشریت میتواند به بهترینها دست یابد.

این شکل از عکسالعمل به معتقدین به خطرات هوش مصنوعی،خود به خود در حال تبدیل شدن به دینِ مهندسان است. خانم گرایمز -موسیقی دان و یکی از افراد شاخص سیلیکونولی- از این که مهندسان هوش مصنوعی در حال طراحی نسخه اولیه فرهنگ جهان هستند، شگفت زده است. او خواستار تشکیل شورای الروند (که تلمیحی به فیلم ارباب حلقهها دارد) شده است. این شورا متشکل از روسای شرکت های کلیدی هوش مصنوعی و دیگرانی خواهد بود که این پدیده را میفهمند و درک میکنند تا برای هوش مصنوعی سیاست گذاری و تعیین خط مشی کنند. خانم گرایمز با آقای ماسک -همسر او- از طریق رد و بدل کردن یک شوخی درباره آزمایش باسیلیسک روکو آشنا شد.

در ماه اکتبر آقای اندرسن مانفیست فنی خوش بینانهی خود را منتشر کرد که مورد تحسین گسترده کارآفرینان سیلیکونولی قرار گرفت. در این مانیفست، او به عملیات تخریب شخصیت علیه تکنولوژی و زندگی که دهه ها طول کشیده است، حمله میکند. به تعبیر او این عملیات تحت پوششها و نامهای مختلفی همچون «اهداف توسعه پایدار»، «مسئولیت اجتماعی»، «اعتماد و ایمنی» و «اخلاق فناوری» صورت میگرفت. به نظر وی هر تلاشی برای کاهش سرعت پیشرفت هوش مصنوعی به قیمت جان انسانها تمام میشود و بنابراین، در حکم قتل است.

مانیفست آقای اندرسن نقش اعتقادنامه نیقیه را برای فرقه پیشرفت بازی میکند: کلمه “ما معتقدیم” حدود ۱۱۳ بار در متن مانیفست آمده است. فهرست قدیسان حامیِ خوشبینِ به تکنولوژیِ او با بیسد بف جزوس -پرسونای یک مهندس سابقِ گوگل در شبکه های اجتماعی- آغاز میشود. او کسی بود که ادعا میکرد شتابگرایی موثر را پایه ریزی کرده است. شتابگرایی موثر -به تعبیر خود او- یک فرادین است که در آن به تکینگی فناوری ایمان ورزیده میشود.

آینده ما در حال حاضر در حال ساخته شدن بر اساس مقاله آقای وینگ -که سه دهه پیش نوشته شد- میباشد؛ اثری که فقط اندیشمندان سیلیکونولی و طرفداران داستانهای علمی تخیلی آن را خواندهاند. فرقههای متخاصم با یکدیگر بحث و مجادله میکنند که آیا مهندسان، نقش خدا را ایفا میکنند یا فقط مانند دکتر فرانکشتاینِ بیخبر از همه جا هستند؟

این تفرقه مذهبی همچون تلهای فریبنده است که باعث میشود گرفتاران در آن احتمالاً احمقانه حرف بزنند یا شاید به امور احمقانه اعتقاد بورزند. البته، بسیاری از افراد در معرض خطرِ هوش مصنوعی میفهمند که مشکلاتی به غیر از مسئله تکینگی وجود دارند، امّا بسیار مشکل است که بتوان در مقابل جذابیت و فریبندگی بی حد و حصر مسئله تکینگی مقاومت کرد. پیش از آن که آقای اندرسون به دام تله فریبنده مذکور بیفتد، استدلالهای دقیقتری را درباره فروتنی مهندسان و پرداختن به مشکلات هوش مصنوعی -در هنگام ظهور آنها- ارائه کرد.

با این وجود، ما نیاز داریم که حتی بیشتر از این حد به سخنان سایر افراد گوش بدهیم. ماه گذشته، در اجلاس جهانی سیاستگذاری هوش مصنوعیِ ریشی سوناک، آقای ماسک درباره نیاز به «سوییچ خاموشی و غیرفعالسازی» برای هوش مصنوعی خصمآمیز اظهاراتی مطرح کرد. اکثریت این اجلاس به خطر x و وعده تحولآفرین هوش مصنوعی اختصاص یافت و پاسخ دیگر سوالات درباره هوش مصنوعی به یک برنامه دیگر با عنوان ai fringe محول شد.

در آنِ واحد، راشل کولدیکات – اندیشمند بریتانیایی هوش مصنوعی- در حال برقراری رویداد fringe of the fringe بود که در آن گروه بسیار متنوعتری از اندیشمندان درباره موضوعاتی که در دستور کار رویدادهای سابق نبودند -مانند اموری مثل جوامع، شفافیت و قدرت- گفتگو میکردند. آنها با ایده ایجاد شورای برگزیدگان موافقت نکرده و آن را پیشنهاد ندادند. در عوض، آنها پیشنهاد کردند که ما باید کاری کنیم که هوش مصنوعی در خدمت ۸ میلیارد نفر باشد و نه در خدمت ۸ میلیاردر! این که به بخشی از صدای این ۸ میلیارد نفر گوش فرا دهیم، ممکن است مفید فایده باشد.»